Technologie die deepfakes kan produceren is overal beschikbaar. (Shutterstock)

Begin maart, a gemanipuleerde video van de Oekraïense president Volodymyr Zelenskyy werd verspreid. Daarin vertelde een digitaal gegenereerde Zelenskyy het Oekraïense nationale leger zich over te geven. De video werd online verspreid, maar werd al snel ontmaskerd als een deepfake - een hyperrealistische maar nep en gemanipuleerde video geproduceerd met behulp van kunstmatige intelligentie.

Hoewel Russische desinformatie een beperkte impact lijkt te hebben, illustreerde dit alarmerende voorbeeld de mogelijke gevolgen van deepfakes.

Deepfakes worden echter met succes gebruikt in ondersteunende technologie. Bijvoorbeeld, mensen die aan de ziekte van Parkinson lijden, kunnen spraakklonen gebruiken om te communiceren.

Deepfakes worden gebruikt in het onderwijs: het in Ierland gevestigde spraaksynthesebedrijf CereProc creëerde een synthetische stem voor John F. Kennedy, hem weer tot leven brengen om zijn historische toespraak te houden.

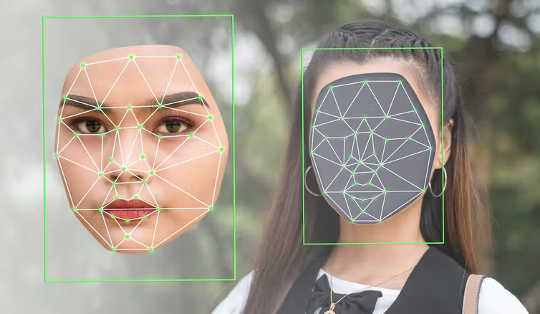

Toch heeft elke munt twee kanten. Deepfakes kunnen hyperrealistisch zijn, en in principe niet detecteerbaar door menselijke ogen.

Daarom zou dezelfde technologie voor het klonen van spraak kunnen worden gebruikt voor phishing, laster en chantage. Wanneer deepfakes opzettelijk worden ingezet om de publieke opinie te hervormen, sociale conflicten aan te wakkeren en verkiezingen te manipuleren, kunnen ze de democratie ondermijnen.

Onderzoekers van de Universiteit van Washington maakten een deepfake van Barack Obama.

Chaos veroorzaken

Deepfakes zijn gebaseerd op technologie die bekend staat als: generatieve vijandige netwerken waarin twee algoritmen elkaar trainen om beelden te produceren.

Hoewel de technologie achter diepe vervalsingen misschien ingewikkeld klinkt, is het eenvoudig om er een te maken. Er zijn tal van online toepassingen zoals: Gezichtsuitwisseling en ZAO Deepswap die binnen enkele minuten deepfakes kunnen produceren.

Google Colaboratory — een online opslagplaats voor code in verschillende programmeertalen — bevat voorbeelden van code die kan worden gebruikt om valse afbeeldingen en video's te genereren. Met software die zo toegankelijk is, is het gemakkelijk in te zien hoe gemiddelde gebruikers grote schade kunnen aanrichten met deepfakes zonder de potentiële beveiligingsrisico's te beseffen.

De populariteit van face-swapping-apps en online services zoals Diepe nostalgie laten zien hoe snel en wijdverbreid deepfakes door het grote publiek kunnen worden geadopteerd. in 2019, er zijn ongeveer 15,000 video's met deepfakes gedetecteerd. En naar verwachting zal dit aantal toenemen.

Deepfakes zijn de perfecte tool voor desinformatiecampagnes omdat ze geloofwaardig nepnieuws produceren dat tijd kost om te ontmaskeren. Ondertussen is de schade die door deepfakes wordt veroorzaakt, vooral die welke de reputatie van mensen aantasten, vaak langdurig en onomkeerbaar.

DeepSwap is een geweldige keuze voor iedereen die met minimale inspanning overtuigende deepfakes wil creëren. ??t;a href="https://twitter.com/hashtag/DeepSwap?src=hash&ref_src=twsrc%5Etfw">#DeepSwap #FaceSwap #DeepFake #FaceApp #Reface #Beoordeling #Recensies #Kunstmatige intelligentie #AI #tech #Technology #TechNieuws #TechnologieNieuws #MENA #TechMGZNhttps://t.co/A2Cbp02sH1

— Techmagazine (@TechMGZN) 4 mei 2022

Is zien geloven?

Misschien wel de gevaarlijkste vertakking van deepfakes is hoe ze zich lenen voor desinformatie in politieke campagnes.

We zagen dit toen Donald Trump elke onflatteuze berichtgeving in de media bestempelde als “nep-nieuws.” Door zijn critici te beschuldigen van het verspreiden van nepnieuws, kon Trump verkeerde informatie gebruiken ter verdediging van zijn wandaden en als propagandamiddel.

De strategie van Trump stelt hem in staat om steun te behouden in een omgeving vol wantrouwen en desinformatie door te beweren "dat echte gebeurtenissen en verhalen nepnieuws of deepfakes zijn. '

Geloofwaardigheid bij autoriteiten en media wordt ondermijnd, waardoor een klimaat van wantrouwen ontstaat. En met de toenemende verspreiding van deepfakes, kunnen politici gemakkelijk de schuld van eventuele opkomende schandalen ontkennen. Hoe kan iemands identiteit in een video worden bevestigd als ze deze ontkennen?

Het bestrijden van desinformatie is echter altijd een uitdaging geweest voor democratieën die proberen de vrijheid van meningsuiting te handhaven. Mens-AI-partnerschappen kunnen helpen om het toenemende risico van deepfakes aan te pakken door mensen informatie te laten verifiëren. Ook zou kunnen worden overwogen nieuwe wetgeving in te voeren of bestaande wetten toe te passen om producenten van deepfakes te straffen voor het vervalsen van informatie en het zich voordoen als personen.

Multidisciplinaire benaderingen door internationale en nationale regeringen, particuliere bedrijven en andere organisaties zijn allemaal van vitaal belang om democratische samenlevingen te beschermen tegen valse informatie.![]()

Over de auteur

Sze-Fung Lee, Onderzoeksassistent, Afdeling Informatiewetenschappen, McGill University en Benjamin CM Fung, Professor en Canada Research Chair in Data Mining for Cybersecurity, McGill University

Dit artikel is opnieuw gepubliceerd vanaf The Conversation onder een Creative Commons-licentie. Lees de originele artikel.